A IBM anunciou em uma carta enviada ao Congresso dos Estados Unidos, e assinada pelo novo presidente-executivo da companhia, Arvind Krishna, que não oferecerá mais sua tecnologia de software de reconhecimento facial, tendo em vista o potencial efeito danoso aos direitos fundamentais dos cidadãos. Além disso, defendeu novos esforços em busca de justiça e equidade racial.

A IBM também anunciou que, além de deixar de oferecer software de reconhecimento facial, se opõe a qualquer uso dessa tecnologia para fins de vigilância em massa e perfil racial, defendendo que novas regras devam ser estabelecidas pelo Congresso Americano para responsabilizar a polícia por má conduta.

A IBM não explicou qual foi o exato momento de sua decisão de deixar pra trás o desenvolvimento da tecnologia de reconhecimento facial, mas ressaltou na carta que este é o momento de iniciar um diálogo nacional sobre se e como a tecnologia de reconhecimento facial deve ser empregada pelas agências domésticas de aplicação da lei.

O anúncio da carta vem a público no momento que os Estados Unidos enfrentam protestos diários após o assassinato de George Floyd, precedidos por pedidos de uma reforma policial.

Afinal, como funciona um algoritmo de reconhecimento facial?

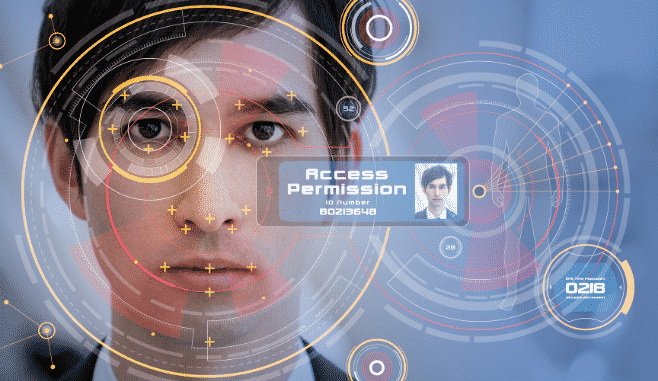

Para entendermos a dimensão do dano em potencial à sociedade pela utilização de algoritmos de reconhecimento facial, precisamos compreender o seu funcionamento. De forma simples, o reconhecimento facial é realizado baseado na identificação de elementos e traços da face humana. São analisados, em detalhes: a distância entre os olhos, largura do nariz, profundidade das órbitas oculares, formato das maçãs do rosto e a linha do maxilar.

Esse conjunto de dados extraídos a partir da face humana alimentam gigantes bases de dados que são utilizadas para que algorítimos reconheçam um rosto. Um exemplo presente em nosso cotidiano é o Google Fotos que nos indica quando uma mesma pessoa aparece em seu acervo lá arquivado. Outra aplicação que faz uso de algoritimo de reconhecimento facial é o próprio Facebook ao sugerir uma marcação de amigos em suas fotos.

No âmbito da esfera pública, muito tem se pensando na utilização de algoritmos de reconhecimento facial para o combate à criminalidade. No entanto, quando se trata de imagens para o reconhecimento de rostos de criminosos, precisamos refletir acerca de como essa base de dados foi composta. Algumas perguntas devem ser respondidas levando em consideração a privacidade dos cidadãos:

- Qual a origem da base de dados que treinará o algoritmo de reconhecimento facial?

- Qual o volume dessa base de dados?

- Houve o consentimento do titular da imagem para a finalidade de treinamento de algoritmos de reconhecimento facial?

Reconhecimento facial: riscos em potencial

Para validar a utilização da tecnologia de reconhecimento facil, vários experimentos foram realizados ao redor do mundo. Dentre eles, destacam-se:

- Nova York fez um teste de reconhecimento de rostos de motoristas que infringem limites de velocidade. A foto de cada barbeiro da ponte Robert Kennedy seria testada contra imagens dos bancos de dados públicos. “[O teste] foi completado e falhou com nenhum rosto (0%) sendo detectado dentro de parâmetros aceitáveis”, diz um memorando obtido pelo Wall Street Journal.

- Em 2017, um teste de tecnologia de reconhecimento facial na final da Champions League no País de Gales apontou 2.470 pessoas no público como tendo antecedentes criminais. No entanto, a experiência controu com 92% de erro.

- A polícia de Londres gastou 200 mil libras num teste de tecnologia de reconhecimento facial que não conseguiu identificar nenhum criminoso.

Outro estudo muito importante e revelador foi realizado pelo MIT que avaliou a assertividade das tecnologias de reconhecimento facial e, segundo eles, os algoritmos trazem mais falsos positivos entre mulheres e negros, especialmente porque são treinados com menos imagens de mulheres e negros gerando algoritmos enviesados (Algorithms Bias).

Para entender melhor sobre algoritmos enviesados e seus problemas, deixamos um vídeos aqui:

Um caso recente foi apreciado pelo Judiciário brasileiro acerca dos riscos e limites da utilização da tecnologia de reconhecimento facial. A Defensoria Pública do Estado de São Paulo, a Defensoria Pública da União, o Instituto de Defesa do Consumidor e o Intervozes recorreram ao judiciário com objetivo de produzir provas acerca do banco de dados do sistema de monitoração eletrônica com reconhecimento facial objeto de processo de licitação LPI nº 10014557, envolvendo as linhas 1-Azul, 2-Verde e 3-Vermelha do metrô de São Paulo.

Sobre o caso, destacamos o seguinte trecho da decisão que solicita maiores explicações ao Metrô de SP. Vejamos:

(1) confiabilidade e eficiência do sistema de monitoração eletrônica objeto do processo de licitação; (2) análise de impacto de proteção de dados, contendo quais dados serão coletados e tratados, a finalidade desse tratamento, o período de retenção dos dados, o grau de risco, a existência de dados definidos como sensíveis pela Lei Geral de Proteção de Dados (LGPD) e as ações de mitigação do risco envolvido; (3) análise do banco de dados já existente, contendo sua data criação e forma de aquisição, as informações de usuários que compõem o banco de dados, o consentimento dados para utilização das informações, forma e frequência de atualização do banco de dados e quem terá acesso aos dados pessoais coletados e quais os graus de privilégios de acesso; (4) forma de obtenção de consentimento de pais e responsáveis pelos dados pessoais de crianças e adolescentes; (5) forma de observância da anonimização e guarda de dados pessoais; (6) análise de impacto financeiro de eventuais falhas e vazamentos na atividade de monitoração eletrônica, considerando todos os usuário do metrô como potenciais afetados; (7) a governança do futuro banco de dados decorrentes da contratação, com detalhamento do controlador, critérios de segurança do armazenamento, usos, formas de acesso e mecanismos de controle social da sua utilização; (8) proposta de compartilhamento de dados com outras entidades estatais e/ou privadas e das hipóteses de tratamento antevistas, permitidas e almejadas;

O debate acerca da utilização de reconhecimento facial no Brasil

Em Abril de 2019, a Comissão de Ciência e Tecnologia da Câmara dos Deputados realizou uma audiência sobre o uso de tecnologia de reconhecimento facial no Brasil. Na oportunidade, os representantes do governos defendem a utilização da tecnologia para o combate à criminalidade no país.

Uma fala que merece destaque e preocupação é a do oficial de inteligência da Agência Brasileira de Inteligência (Abin) Filipe Soares, integrante do Gabinete de Segurança Institucional da Presidência da República, ao afirmar que o reconhecimento facial pode ser utilizado para rastrear fugitivos, agressores, desaparecidos, suspeitos de terrorismo e potenciais espiões. E que

“Aceitamos muito facilmente a vigilância promovida por empresas privadas, como o Google, mas somos reticentes quanto à vigilância realizada pelo Estado”

Para auxiliar na reflexão acerca da fala destacada, recomendamos a leitura do artigo da Professora Shosha Zuboff – Big Other: Surveillance Capitalism and the Prospects of an Information Civilization – disponível aqui.

Deixamos, também, como dica para quem quer adentrar ao tema, o vídeo abaixo:

Carta da IBM sobre a tecnologia de reconhecimento facial

Confira, a seguir, o conteúdo original da carta da IBM ao Congresso dos Estados Unidos (Tradução nossa):

Caros senadores Booker e Harris, e representantes Bass, Jeffries e Nadler:

Em setembro de 1953, mais de uma década antes da aprovação da Lei dos Direitos Civis, a IBM adotou uma posição ousada em favor da igualdade de oportunidades. Thomas J. Watson Jr., então presidente da IBM, escreveu a todos os funcionários:

”. . .Cada um dos cidadãos deste país tem o mesmo direito de viver e trabalhar na América. É política desta organização contratar pessoas que possuam a personalidade, talento e formação necessária para preencher um determinado cargo, independentemente de raça, cor ou crença. ”

Watson fez backup dessa declaração com uma ação, recusando-se a aplicar as leis de Jim Crow nas instalações da IBM. No entanto, quase sete décadas depois, as horríveis e trágicas mortes de George Floyd, Ahmaud Arbery, Breonna Taylor e muitos outros nos lembram que a luta contra o racismo é mais urgente do que nunca.

Para esse fim, a IBM gostaria de trabalhar com o Congresso na busca da justiça e da equidade racial, concentrada inicialmente em três áreas políticas principais: reforma da polícia, uso responsável da tecnologia e ampliação de habilidades e oportunidades educacionais. Nossas sugestões incluem:

Reforma da polícia – novas regras federais devem responsabilizar a polícia por má conduta.

O Congresso deveria submeter mais casos de má conduta policial ao âmbito do tribunal federal e fazer modificações na doutrina de imunidade qualificada que impede os indivíduos de buscar danos quando a polícia viola seus direitos constitucionais. O Congresso também deve estabelecer um registro federal de má conduta policial e adotar medidas para incentivar ou obrigar estados e localidades a revisar e atualizar políticas de uso da força. Também instamos o Congresso a considerar uma legislação como a Lei de Notificação Walter Scott, patrocinada pelo senador Tim Scott, da Carolina do Sul, que exigiria que os estados que recebem financiamento federal relatassem mais detalhes sobre o uso da força mortal por policiais no Departamento de Justiça. Justiça para que uma imagem precisa de tais incidentes esteja disponível para análise e escrutínio público.

Várias dessas sugestões estão incluídas na Lei Justiça no Policiamento de 2020, que você introduziu recentemente. A IBM agradece sua liderança inicial no anúncio dessas propostas e está pronta para trabalhar com você e outros membros do Congresso, de ambos os lados do corredor, em direção a uma ampla legislação bipartidária que pode ser promulgada em lei.

Políticas tecnológicas responsáveis - a tecnologia pode aumentar a transparência e ajudar a polícia a proteger as comunidades, mas não deve promover discriminação ou injustiça racial.

A IBM não oferece mais software de análise ou reconhecimento facial IBM de uso geral. A IBM se opõe firmemente e não tolerará o uso de nenhuma tecnologia, incluindo a tecnologia de reconhecimento facial oferecida por outros fornecedores, para vigilância em massa, criação de perfil racial, violações de direitos humanos e liberdades básicas ou qualquer finalidade que não seja consistente com nossos valores e Princípios de Confiança e transparência. Acreditamos que agora é a hora de iniciar um diálogo nacional sobre se e como a tecnologia de reconhecimento facial deve ser empregada pelas agências policiais nacionais.

A inteligência artificial é uma ferramenta poderosa que pode ajudar a aplicação da lei a manter os cidadãos seguros. Porém, fornecedores e usuários de sistemas de IA têm uma responsabilidade compartilhada de garantir que IA seja testada quanto a viés, particularidade quando usado na aplicação da lei, e que esse teste de viés seja auditado e relatado.

Finalmente, a política nacional também deve incentivar e avançar o uso de tecnologia que traga maior transparência e responsabilidade ao policiamento, como câmeras corporais e técnicas modernas de análise de dados.

Expansão de oportunidades – o treinamento e a educação de habilidades sob demanda são essenciais para expandir as oportunidades econômicas para comunidades de cor.

Precisamos criar caminhos mais abertos e equitativos para que todos os americanos adquiram habilidades e treinamento comercializáveis, e a necessidade é particularmente aguda nas comunidades de cor. Na IBM, vemos uma demanda urgente pelo que chamamos de empregos de “colarinho novo”, que exigem habilidades especializadas, mas não necessariamente um diploma universitário tradicional de quatro anos. Esses trabalhos ainda podem ser encontrados hoje em campos de rápido crescimento, da segurança cibernética à computação em nuvem. Instamos ao Congresso a considerar políticas nacionais para expandir o número e o alcance de programas como:

P-TECH – Desenvolvido pela IBM no início desta década, o P-TECH é um modelo de escola de 9 a 14 anos em que os alunos obtêm seu diploma do ensino médio e um diploma de associado sem custo em um campo STEM sem incorrer em dívidas estudantis. Hoje, 220 escolas P-TECH estão atendendo a 150.000 estudantes em todo o mundo, com um forte foco em estudantes de cor em áreas carentes de educação nos Estados Unidos. Do Brooklyn a Chicago, de Dallas a Baltimore, essas escolas estão criando oportunidades reais e empregos reais para os jovens de hoje. Devemos escalá-los nacionalmente.

Pell Grants – Hoje, o Pell Grants é um caminho importante para estudantes de cor para ir para a faculdade. Mas praticamente não há fundos federais disponíveis para treinamento de habilidades que não sejam da faculdade ou programas de certificação de empregos para empregos sob demanda da New Collar. A qualificação para o Pell Grants deve ser expandida – inclusive para pessoas encarceradas – além dos programas tradicionais de quatro anos, para que os alunos com necessidade econômica real possam desenvolver habilidades relevantes por meio de outras vias de educação e treinamento que se adaptem às circunstâncias da vida.

Oferecemos essas sugestões no espírito construtivo de solução de problemas que sempre definiu nossa empresa e seu pessoal. Percebemos que essas medidas são apenas um começo, mas a IBM quer ajudar a promover a busca por eqüidade e justiça neste país e estamos prontos para trabalhar com você no desenvolvimento de políticas que ajudarão a unificar nosso país e a promover nosso objetivo nacional.

Atenciosamente,

Arvind Krishna

Fonte: Reuters, Câmara, Medium de Marcelo Sorares, CNBC, Estadão e IBM.

Para Assessoria Jurídica e Adequação às leis de Proteção de Dados (Consultoria LGPD), contate agora os nossos Advogados

Para mais informações ou se tiver dúvidas sobre Direito Digital, em especial acerca dos temas: Proteção de Dados (Consultoria LGPD), Aspectos Regulatórios e Compliance de novas tecnologias, entre em contato pelo e-mail [email protected] ou fale com um Advogado online agora.

BL Consultoria e Advocacia Digital

Escritório jurídico voltado para o mundo conectado que busca auxiliar empresas e startups a desenvolverem seus projetos (Pesquisa, Desenvolvimento e Inovação) de forma ética e eficiente com atuação especializada em Direito Digital e Análise Regulatória para novas tecnologias. Estamos localizado em dois endereços: em São Paulo-SP, na Av. Paulista, 575 – conjunto 1903 – Bela Vista, CEP 01311-911 e em Campinas-SP, na Rua Antônio Lapa, 280 – 6o andar, Cambuí. Para mais informações ou consultoria jurídica com nossos advogados, agende uma reunião pelo link ou ligue +55 11 3090 5979.